LaCulturaDelDato #213

Dati & algoritmi attraverso i nostri 5 sensi

For my English speaking friends, click here for the translated version

Ciao,

sono Stefano Gatti e questo è il duecentotredicesimo numero della newsletter LaCulturaDelDato: dati & algoritmi attraverso i nostri 5 sensi. Le regole che ci siamo dati per questo viaggio le puoi trovare qui.

Ecco i cinque spunti del duecentotredicesimo numero:

👃Investimenti in ambito dati e algoritmi. Natalità: il dato che può ridisegnare i mercati e gli investimenti

Nell’edizione 91 ti avevo segnalato una data-story di EDJNet sul calo della natalità in Europa. Era stato l’approfondimento più letto e riletto oggi, fa ancora più impressione, perché il trend non solo continua: si consolida. Secondo Eurostat, nel 2024 il tasso di fertilità dell’UE è sceso a 1,34 figli per donna, il valore più basso dell’intera serie UE disponibile. In Italia siamo a 1,18, nuovo minimo storico; in Finlandia il 2024 ha segnato il livello più basso dall’inizio delle statistiche, nel 1776. Anche la Francia continua a scendere: 1,62 nel 2024.

Secondo me, il punto interessante non è solo demografico. È economico, industriale e, sempre di più, tecnologico (ne parla anche l’approfondimento successivo sempre in questa newsletter). Quando nascono meno persone e la popolazione invecchia, cambiano i mercati che crescono: formazione continua per adulti e senior, reskilling, long-term care, robotica di assistenza, prevenzione e sanità. Cambia anche il tipo di produttività di cui avremo bisogno. Qui la demografia smette di essere una nota a margine e diventa una variabile strategica. C’è poi un punto che avevo già sollevato allora e che oggi mi sembra ancora più importante: la migrazione può attenuare il declino demografico, ma non compensare da sola tassi di fertilità persistentemente bassi, come mostra anche una recente analisi del Joint Research Centre della Commissione europea. Per questo torno sul tema: la convergenza tra meno nascite, più longevità e carenza di personale sanitario sta passando dall’essere un rischio teorico a una pressione operativa. L’OMS ha aggiornato a circa 11 milioni la carenza globale di operatori sanitari prevista per il 2030. E la domanda di cura è destinata a crescere: in uno studio USA sulla popolazione over 50, le persone con almeno una patologia cronica sono stimate quasi raddoppiare tra 2020 e 2050.

E qui entra l’intelligenza artificiale. Non come gadget, ma come infrastruttura di servizio. Nel healthcare siamo già oltre la fase puramente esplorativa: una survey McKinsey condotta a fine 2024 rileva che l’85% dei leader sanitari intervistati stava esplorando o aveva già adottato soluzioni di generative AI. Documentazione clinica, triage, follow-up, ottimizzazione dei turni: sono casi d’uso che iniziano a spostarsi dai piloti alla scala. E i numeri sono ancora in crescita

Da investitore, la mia tesi resta quindi quella dell’edizione 91, solo più convinta: gli AI assistant, in sanità, nell’assistenza e nella formazione, non saranno un “nice to have”, ma uno degli strumenti necessari per mantenere livelli di servizio accettabili in società con meno persone in età lavorativa e più bisogni di cura. È la prima volta, almeno nella storia economica moderna europea, che vediamo questa combinazione su scala così ampia. E già questo basta per trattarla come una variabile centrale, non come una curiosità statistica.

🖐️Tecnologia (data engineering). Il software conta ancora. Ma da solo conta meno.

C’è un articolo di Kurt Cagle che merita assolutamente di essere letto non perché dica qualcosa del tutto nuovo sull’AI applicata al codice, ma perché porta la discussione su un terreno più interessante: quello dell’organizzazione e dell’evoluzione del ruolo del programmatore. La sua tesi, ripulita da alcune punte più speculative, è semplice. Il software non scompare, ma perde centralità come prodotto autonomo e diventa sempre più infrastruttura, componente, strato abilitante. E quando cambia il posto del software nella catena del valore, cambiano anche i team che lo costruiscono, lo governano e lo usano. Cagle lo racconta con formule nette come Fewer General Programmers e More Producers: meno peso del programmatore generalista, più spazio per figure capaci di assemblare rapidamente componenti, dati, modelli e interfacce per risolvere problemi concreti. In fondo è un processo che vediamo da anni. Cloud, piattaforme, API, container e servizi managed hanno già abbassato la soglia di complessità necessaria per costruire una soluzione robusta. L’AI generativa non apre questa traiettoria. La accelera. Per questo il punto non è dire che il codice non serve più. Serve ancora, eccome. Ma vale meno, da solo, come fonte di differenziazione. Conta di più il contesto in cui quel codice vive: dati, processi, vincoli, sicurezza, integrazione, esperienza utente. Qui entra un passaggio che secondo me va reso ancora più esplicito. L’orientamento al prodotto cresce, ma in una forma diversa da quella classica del software vendor. Non si tratta solo di vendere licenze o piattaforme. Si tratta di costruire soluzioni che funzionano davvero per un utente, interno o esterno, con tempi molto più compressi. È vicino a ciò che Cagle mette sotto Intent Matters: il vero collo di bottiglia non è più soltanto implementare, ma capire bene che cosa va risolto, per chi, con quali dati e con quali vincoli. Il problema prima del codice. L’intento prima della tecnologia.

Da qui cambia anche la geografia dei ruoli. Il programmatore enterprise non sparisce, ma si riposiziona. Se, come scrive Cagle, Frameworks Become Infrastructure, allora una quota crescente del codice standard tenderà a essere generata, configurata o assemblata a partire da template, starter kit e componenti riusabili. Il valore si sposta quindi verso chi progetta le condizioni operative: interfacce sicure, accessi, qualità dei dati, observability, compliance, performance, integrazione tra sistemi. Meno lavoro manuale ripetitivo. Più architettura. E c’è un altro passaggio molto utile per chi lavora con dati e AI. Cagle parla di Rise of the Subject Matter Expert Programmer. Tradotto: cresce il peso dell’esperto di dominio che usa il software come leva, non come identità professionale. Un medico, un legal specialist, un esperto di supply chain o di finance, aiutato da strumenti AI, può costruire soluzioni molto più vicine al bisogno reale di quanto non faccia un team lontano dal contesto. Questo allarga il perimetro di chi “programma”, ma rende ancora più importante avere fondamenta solide. Perché più creatività distribuita senza una base comune significa solo più frammentazione.

Ed è qui che il tema dati torna centrale. Se aumentano le soluzioni locali allora la vera risorsa strategica è una condivisione di strumenti e artefatti: dati accessibili, definizioni coerenti, standard minimi, policy di accesso, semantica comune. Cagle spinge oltre e parla di Distributed Digital Twins e persino di The Post Programming Era. Io la leggerei così: meno ossessione per il linguaggio, più attenzione a come rappresentiamo il mondo, i processi e le relazioni tra sistemi. Per questo non parlerei di fine del software. Parlerei della fine del software da solo. E quindi, per i team, della fine di una divisione troppo rigida tra chi costruisce, chi governa i dati e chi conosce il business. Il lavoro si sposta verso chi riesce a tenere insieme queste tre cose.

👂🏾Organizzazione e cultura dei dati e algoritmi nelle organizzazioni. L’AI in area legal: quando il testo è il prodotto, l’AI sembra cambiare veramente le regole del gioco ma …

Guardando il mio database di start-up degli ultimi due anni, c’è un pattern che salta agli occhi: tolti i soliti verticali tech e coding, le due aree aziendali dove l’AI generativa si è concentrata di più sono Legal e HR. Non è un’impressione solo mia: nel database di Y Combinator, il più grande acceleratore al mondo, le start-up legal-tech finanziate sono state più di 50, di cui almeno 27 incubate negli ultimi due anni. Parliamo di oltre il 2% delle aziende nel portfolio: un numero grande per un singolo verticale. E secondo Crunchbase, nel 2025 il funding globale per legal-tech ha toccato i 4,08 miliardi di dollari, +77% rispetto al 2024.

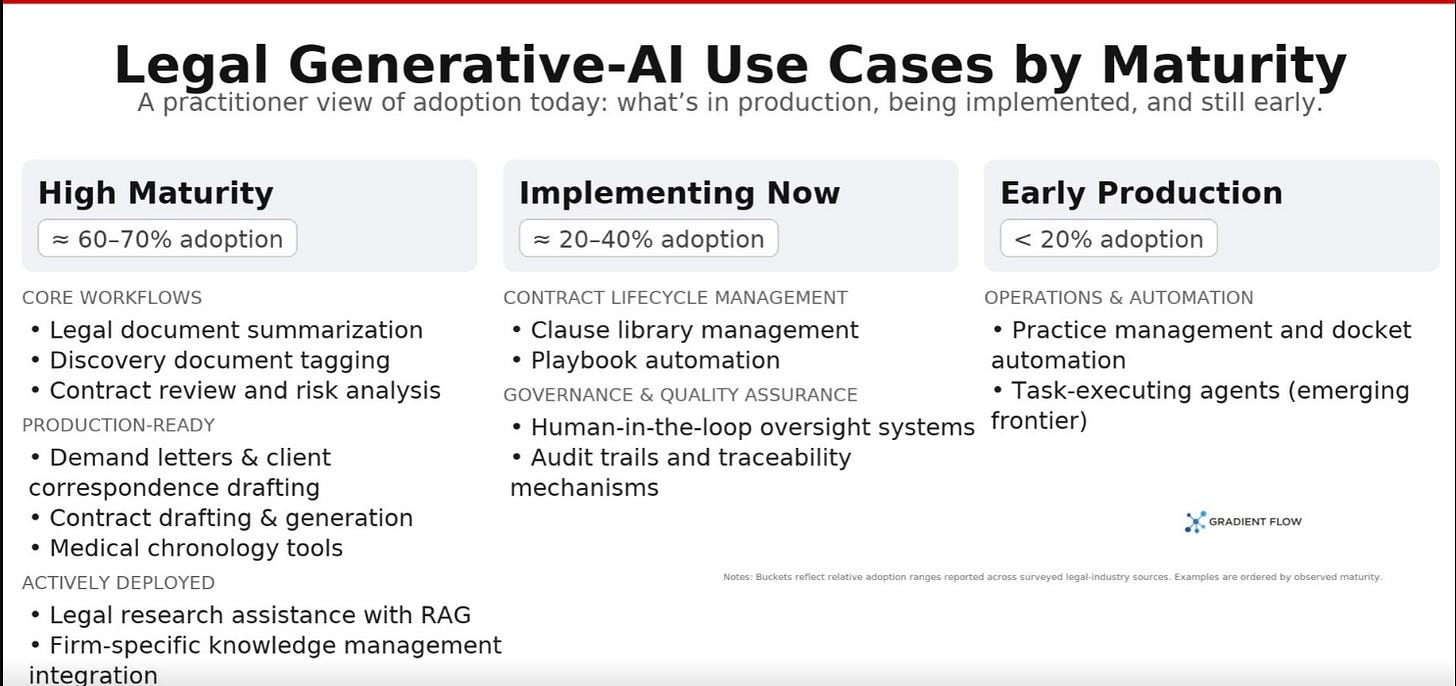

Ma perché proprio il legal? Ben Lorica 罗瑞卡, una delle voci più autorevoli nell’analisi dell’AI enterprise, ha pubblicato su Gradient Flow un pezzo che ti consiglio di leggere per intero (“AI’s Biggest Enterprise Test Case is Here”). La tesi è che il settore legale sia oggi lo stress test definitivo per l’AI generativa in azienda: se il tuo sistema riesce a sopravvivere ai vincoli di confidenzialità, alle barriere informative tra clienti (ethical wall) e alla tracciabilità completa (audit trail), allora può funzionare ovunque. Il motivo è strutturale: la professione legale è fatta quasi interamente di testo: ricerca, redazione, analisi documentale, revisione contrattuale. È il terreno ideale per i modelli linguistici, ma anche il più insidioso: gli errori non sono bug, sono responsabilità professionali.

Lorica mappa il panorama in tre fasce di maturità. I casi ad alta maturità (adozione del 60–70%) sono quelli dove l’AI è già in produzione: sintesi di documenti legali, classificazione documentale per la fase istruttoria, revisione contrattuale e analisi del rischio. Nella fascia intermedia (20–40%) troviamo la gestione del ciclo di vita dei contratti, librerie di clausole, manuali negoziali automatizzati, e i sistemi di governance con supervisione umana e tracciabilità completa. Infine, la frontiera (sotto il 20%): automazione della gestione dello studio e, soprattutto, i primi agenti AI che eseguono catene di attività in autonomia. La maggior parte dei prodotti legal-AI sul mercato, avverte però Lorica, sono ancora strati sottili sopra modelli general-purpose, con tuning legale limitato, comportamento opaco e tracciabilità debole. La tensione tra potenziale e rischio è il cuore della questione, ed è ciò che rende questo verticale così istruttivo per chiunque stia pensando all’AI in azienda.

Se il tema ti appassiona, nella newsletter l’ho toccato più volte. Ecco una mappa per orientarti, con un aggiornamento sulle start-up che avevo segnalato:

🗂️ #053 — Intervista a Massimiliano Nicotra, l’avvocato “nerd”

Aggiornamento: @MassimilianoNicotra continua a essere un punto di riferimento sulla GenAI giuridica in Italia.

🗂️ #067 — Start-up del mese: Spellbook

Aggiornamento: Crescita esplosiva: Series B da $50M (valutazione $350M), $40M di credito per acquisizioni, in rotta verso $100M di ARR nel 2026. Partner esclusivo della Canadian Bar Association.

🗂️ #091 — Fine-tuning LLM in ambito legale

Aggiornamento: Il tema resta caldissimo, ma il trend si sposta verso RAG + knowledge graph.

🗂️ #130 — Intervista a Claudia Morelli + start-up del mese Leyla

Aggiornamento: Leyla si è ribattezzata Legora: Series D da $550M, valutazione $5,55 miliardi (!), 250 dipendenti, espansione USA. Da Stoccolma a unicorno in meno di 3 anni.

🗂️ #174 — Back to Nicotra e la GenAI giuridica

Aggiornamento: Guida ai prompt per avvocati e assistente DPO personalizzato.

🗂️ #189 — Start-up del mese: Lexroom.ai

Aggiornamento: La milanese Lexroom ha chiuso una Series A da €16M, ha superato €10M di ARR con 7.000 clienti, ed è sbarcata in Germania e Spagna. Target: €40M entro fine 2026.

Tre traiettorie diverse, canadese, svedese e italiana, che raccontano la stessa cosa: il legal-tech AI è un mercato in piena accelerazione.

👀Data Science. Dalla statistica “da newsroom” alle equazioni del deep learning 🙂

Sai quanto amo strumenti che spiegano concetti complessi, o comunque astratti, in maniera visuale e con esempi pratici. O, per dirla in maniera sintetica, con una definizione che ti avevo introdotta proprio la scorsa puntata: Explorable Explanations.

Sai anche che i concetti base della statistica sono, come avevo scritto nel libro che ho scritto con Alberto Danese, una delle basi della Cultura del dato. Ecco: l’approfondimento che ti suggerisco in questa sezione della newsletter unisce questi due concetti e va al di là del titolo, un po’ fuorviante, e cioè “Matematica per giornalisti”. Math for Journalists è un notebook interattivo costruito su Observable, pensato esattamente per colmare un gap esistente: aiutare i giornalisti, e chiunque lavori con i dati, a padroneggiare i concetti matematici e statistici che compaiono più frequentemente nelle storie di cronaca, economia e politica. La scelta della piattaforma non è casuale: Observable permette di spiegare concetti con esempi vivi e modificabili in tempo reale, trasformando la lettura in un’esperienza attiva. Non si legge la formula, si gioca con la formula. Il contributo è aperto, gratuito, già usato in formazione interna, con l’autore che lo ha condiviso pubblicamente dopo averlo presentato ai colleghi della sua redazione. Uno dei casi di open science che più ci piacciono.

L’autore di questo lavoro è Naël Shiab, un giornalista di Montreal specializzato in data storytelling e inchieste data-driven per CBC/Radio-Canada. Ha creato simple-data-analysis, una libreria TypeScript open source ad alte prestazioni per l’analisi di dati tabulari e geospaziali, e il corso online Code Like a Journalist, dedicato all’analisi e alla visualizzazione dei dati in TypeScript. Nel 2023 ha vinto il premio RTDNA Canada per l’eccellenza nel data storytelling.

Se hai trovato stimolante ma scontato il notebook di Shiab, potresti trovare più interessante questo altro approfondimento: Essential Machine Learning Equations: A Reference Guide, che è una guida pratica alle fondamenta matematiche del machine learning, costruita attorno alle equazioni che l’autore usa nel suo lavoro quotidiano: non un elenco esaustivo, ma un riferimento operativo. Si parte dall’information theory (entropia, cross-entropy, KL divergence, Bayes) per arrivare a reti neurali, backpropagation, meccanismo di attenzione e diffusion models. Ogni formula è accompagnata da un’implementazione Python funzionante. L’autore è Chizoba Obasi, deep learning enthusiast che costruisce in pubblico su GitHub e Kaggle con un approccio da practitioner: niente accademia, tutto applicato. Perfetto per chi vuole un ponte tra la matematica dei giornalisti e quella dei modelli 🙂

👅Etica & regolamentazione & impatto sulla società. L’AI literacy non esiste. Esiste quella di storia, quella di matematica, quella di data science …

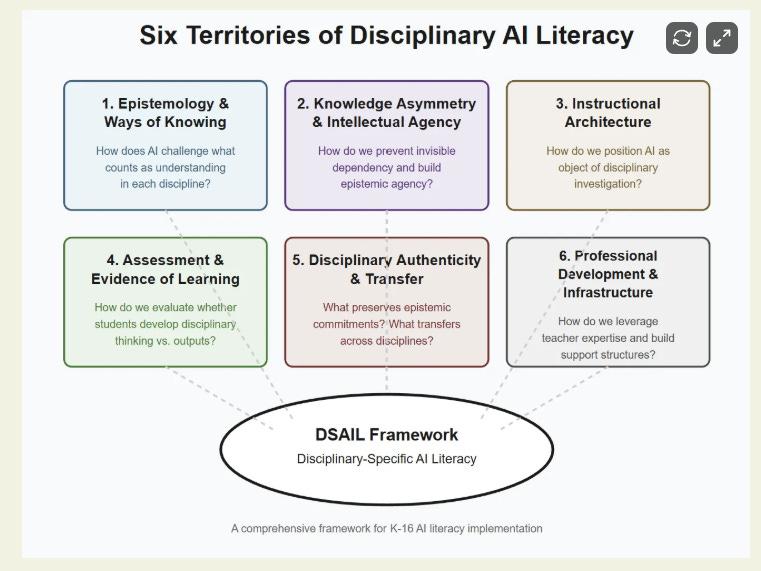

Nick Potkalitsky, ricercatore americano che segue da vicino l’intersezione tra AI e didattica, ha pubblicato una mappa di sei territori concettuali che chiunque si occupi di formazione deve attraversare.

Potkalitsky crea questo framework per il mondo della scuola (americana) ma approfondendolo sono convinto che possa valere allo stesso modo tanto per l’università quanto, forse soprattutto, per le aziende. Perché i problemi che incontriamo nell’uso dell’AI in questa fase di transizione mi sembrano molto comuni. L’idea di fondo è semplice: non puoi insegnare AI literacy in modo generico e trasversale. Devi farlo dentro le discipline, dentro i mestieri, dentro i contesti dove il pensiero conta davvero.

Il primo errore da correggere riguarda il rischio reale dell’AI. Il problema non è che possa sbagliare ma è che può essere accurata svuotando il processo cognitivo che normalmente produce quella risposta. Uno studente ottiene un’analisi corretta senza imparare ad analizzare. Un analista produce un report senza imparare a ragionare sui dati. Potkalitsky chiama questo “spostamento epistemico”: l’AI fa il lavoro intellettuale, ma chi la usa non lo internalizza. Da qui nasce un’asimmetria che è moltiplicativa, non additiva. La formula è diretta: basi disciplinari solide × comprensione dell’AI = agency intellettuale. Se uno dei due fattori è zero, il prodotto è zero. Chi ha già competenze usa l’AI per accelerare e valuta criticamente ogni output. Chi non le ha sviluppa una dipendenza invisibile: produce risultati accettabili, passa i test, non impara niente. Il problema è che dall’esterno non si vede la differenza.

Questo porta al punto più controintuitivo del framework, quello sull’architettura didattica. La sequenza conta più di qualsiasi strumento. L’errore comune è insegnare prima “come si usa l’AI”, poi applicarla alla disciplina. Dovrebbe essere il contrario: prima si costruiscono gli standard del mestiere, poi si porta l’AI come oggetto di indagine, non come strumento da usare subito. Solo così chi impara ha un metro per valutare dove l’AI manca, cosa salta, dove il suo giudizio è insostituibile. Potkalitsky chiama questo risultato “scetticismo guadagnato”: non una regola imposta dall’esterno, ma una consapevolezza costruita dall’interno.

La valutazione, di conseguenza, deve cambiare forma. Con l’AI la domanda “hai fatto il compito?” non dice più nulla. Bisogna distinguere tre livelli: chi delega il ragionamento all’AI, chi la usa come risorsa in un processo che dirige comunque lui, chi la usa per capire meglio la disciplina stessa. Tre situazioni che dall’esterno producono output simili, ma che costruiscono competenze completamente diverse nel tempo.

Su tutto questo si innesta il tema dell’autenticità. L’uso corretto dell’AI non dipende dagli strumenti che usano i professionisti del settore: dipende da se quell’uso preserva o bypassa il ragionamento che definisce l’expertise. Quattro ruoli restano umani indipendentemente dalla disciplina: Critico, Interlocutore, Editor, Verificatore. Cambia come si esercitano, non che esistono.

Infine, la formazione dei formatori. I trainer aziendali non hanno bisogno di diventare esperti di AI in generale. Hanno bisogno di capire cosa l’AI fa e non fa nella loro funzione specifica. Un data scientist deve sapere che l’AI eccelle nell’esecuzione tecnica ma può saltare il problem framing e il ragionamento causale. Un manager deve sapere che l’AI sintetizza benissimo ma non valuta la qualità delle fonti. Quella consapevolezza funzionale, specifica, operativa, guadagnata sul campo, è l’unica AI literacy che conta davvero.

In un contesto aziendale la posta in gioco è identica a quella universitaria, ma meno visibile. Nessuno vede il dipendente che smette di allenare il pensiero critico perché l’AI lo ha sostituito nel passaggio più faticoso. Il framework di Potkalitsky suggerisce una cosa pratica: progetta la formazione con la sequenza giusta. Prima mostra al tuo team come si ragiona bene in quella funzione, poi usa l’AI come specchio per far vedere dove e perché il ragionamento umano resta centrale. Non “vietate l’AI”. Non “usate l’AI per tutto”. Costruite lo scetticismo guadagnato che è il messaggio centrale della mappa dell’AI Literacy di Potkalitsky.

📅 Nel Mio Calendario (passato, presente e futuro)

Come si evolverà il ruolo di chi lavora con i dati? Ne ho parlato questa settimana in un'intervista con Irene DI Deo per gli Osservatori del Politecnico di Milano. Abbiamo esplorato il mondo dei Data Expert del futuro (e mi sono divertito molto a farlo!). Se vi va di ascoltarla, la trovate qui.

Se hai ulteriori suggerimenti e riflessioni sui temi di questo numero o per migliorare questa newsletter scrivimi (st.gatti@gmail.com) o commenta su substack.

Se ti è piaciuta e non sei ancora iscritto lascia la tua mail qui sotto e aiutami a diffonderla!

Alla prossima!

La robotica di assistenza e’ assolutamente da guardare molto da vicino. Leggevo sul FT di come in Corea del Sud si stiano già diffondendo delle bambole basate su chat gpt per assistenza agli anziani soli (anche un po’ inquietante ). Sarebbe interessante capire quali sono le start up più interessanti che stanno operando nel settore.